Okolicznością, która odróżnia autonomiczne roboty (w tym pojazdy autonomiczne) od znanych nam dzisiaj rozwiązań technicznych, jest to, że bezpośrednim powodem wyrządzonej szkody może być zasadniczo ich działanie. Związek przyczynowy niezbędny do zaistnienia odpowiedzialności będzie więc istniał przede wszystkim pomiędzy szkodą a działaniem robota.

Istnieje bowiem ryzyko, że niemożliwe będzie ustalenie związku przyczynowego (nawet pośredniego) pomiędzy szkodą a określonym działaniem człowieka (np. twórcy algorytmu). Stanowi to ogromne wyzwanie dla współczesnego systemu odpowiedzialności cywilnej, który niewątpliwie dąży do ustalenia osoby odpowiedzialnej za szkodę. W przypadku działania wywołanego przez autonomiczne decyzje robota może się to okazać niemożliwe.

Jako najczęstsze przyczyny powstania szkody wyrządzonej przez roboty przyjmuje się:

• fabryczne uszkodzenie jednego z sensorów robota skutkujące deformacją procesów decyzyjnych robota,

• ewidentne błędy w algorytmie maszyny (np. wprowadzenie do algorytmu autonomicznych pojazdów błędnych założeń dotyczących zasad ruchu drogowego),

• włamanie do systemu robota i zainstalowania złośliwego oprogramowania.

Skomplikowane stany faktyczne mogą również powstawać w odniesieniu do obecnych już na rynku rozwiązań hybrydowych, które przewidują częściową automatyzację pewnych procesów, przy jednoczesnym nadzorze i kontroli człowieka (np. automatyczne systemy wspomagania nawigacji we współczesnych statkach lub autopilot w samolotach).

W sytuacjach, w których będzie możliwe zidentyfikowanie adekwatnego związku przyczynowego pomiędzy działaniami maszyny wyrządzającymi szkodę a działaniami określonych osób (np. twórcy algorytmu lub producenta wadliwego podzespołu), będzie można rozważać również pociągnięcie do odpowiedzialności określonych osób, w tym na zasadzie winy. Tak będzie przykładowo w przypadku ustalenia, że określone działanie robota było spowodowane uszkodzeniem sensora, które z kolei wynikało z braku należytej konserwacji ze strony właściciela robota.

Jednak największe wyzwanie dla ustalenia odpowiedzialności cywilnej stanowią te działania, które są wynikiem w pełni autonomicznych decyzji systemu operacyjnego robota, na których kształt nie wpłynęło nieprawidłowe działanie systemu (np. uszkodzony sensor) ani ewidentne błędy w algorytmie. W przypadku takich działań nie sposób zidentyfikować związku przyczynowego pomiędzy działaniem człowieka a zaistniałą szkodą. Dlatego w odniesieniu do takich szkód nie ma możliwości wykorzystania w dużej mierze funkcjonujących obecnie instytucji prawnych w zakresie odpowiedzialności, albowiem większość przepisów jest oparta na założeniu, że działanie będące źródłem szkody jest działaniem człowieka a nie maszyny.

Odpowiedzialność prowadzącego przedsiębiorstwo lub zakład (art. 435 k.c.)

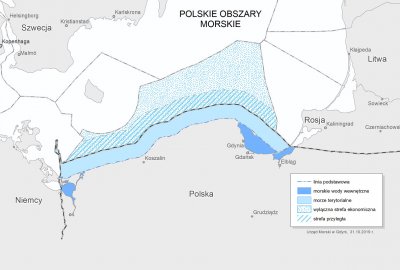

Nie oznacza to jednak, że za takie, w pełni autonomiczne, działania robotów nie będzie można ponosić odpowiedzialności. W przypadku, w którym roboty są częścią przedsiębiorstwa np. portów morskich, nie można wykluczyć odpowiedzialności przewidzianej w art. 435 Kodeksu cywilnego, który stanowi, iż „prowadzący na własny rachunek przedsiębiorstwo lub zakład wprawiany w ruch za pomocą sił przyrody (pary, gazu, elektryczności, paliw płynnych itp.) ponosi odpowiedzialność za szkodę na osobie lub mieniu, wyrządzoną komukolwiek przez ruch przedsiębiorstwa lub zakładu, chyba że szkoda nastąpiła wskutek siły wyższej albo wyłącznie z winy poszkodowanego lub osoby trzeciej, za którą nie ponosi odpowiedzialności”.

Należy przy tym zauważyć, że: „Ruch przedsiębiorstwa jest rozumiany szeroko, a więc nie tylko jako działanie urządzeń bezpośrednio napędzanych siłami przyrody, lecz jako ruch całokształtu przedsiębiorstwa. Dlatego też odpowiedzialność z art. 435 pojawi się także wówczas, gdy szkoda wynikła z niewłaściwego działania takich elementów struktury przedsiębiorstwa, które nie są poruszane siłami przyrody (oczywiście przy założeniu, że przedsiębiorstwo jako całość jest tymi siłami napędzane). Tak więc obowiązek naprawienia szkody na podstawie komentowanego przepisu będzie powodowała nie tylko np. katastrofa kolejowa, ale także upadek pasażera, który poślizgnął się na oblodzonym peronie. Wszystko to jest uzasadnione traktowaniem przedsiębiorstwa jako jednolitej struktury, która jako całość jest źródłem podwyższonego niebezpieczeństwa wyrządzenia szkody. Działanie poszczególnych elementów tej struktury, pomimo ich zróżnicowanego charakteru, nie powinno zatem powodować odmiennych skutków w sferze odpowiedzialności deliktowej” (Karaszewski Grzegorz. Art. 435. W: Kodeks cywilny. Komentarz. Wolters Kluwer Polska, 2019).

Produkt niebezpieczny

Działania autonomicznych pojazdów czy robotów zasadniczo już dzisiaj mogą powodować powstanie odpowiedzialności za produkt niebezpieczny. Odpowiedzialność ta będzie spoczywała przede wszystkim na producentach robotów.

Warto jednak podkreślić, że do powstania odpowiedzialności za produkt niebezpieczny muszą zaistnieć określone przesłanki. Zgodnie bowiem z art. 4491 § 3 Kodeksu cywilnego produktem niebezpiecznym jest produkt „niezapewniający bezpieczeństwa, jakiego można oczekiwać, uwzględniając normalne użycie produktu. O tym, czy produkt jest bezpieczny, decydują okoliczności z chwili wprowadzenia go do obrotu, a zwłaszcza sposób zaprezentowania go na rynku oraz podane konsumentowi informacje o właściwościach produktu. Produkt nie może być uznany za niezapewniający bezpieczeństwa tylko dlatego, że później wprowadzono do obrotu podobny produkt ulepszony”. O tym, czy produkt jest bezpieczny, decydują okoliczności z chwili wprowadzenia go do obrotu, a zwłaszcza sposób zaprezentowania go na rynku oraz podane konsumentowi informacje o właściwościach produktu. W tym miejscu można odnieść się do licznych bardzo szczegółowych instrukcji przygotowywanych na rynek amerykański, np. w wielu instrukcjach kuchenek mikrofalowych zawarto ostrzeżenie, iż nie jest to urządzenie do suszenia mokrych żywych zwierząt lub że tempomat w samochodzie nie jest w istocie autopilotem tylko odpowiada za utrzymanie stałej prędkości pojazdu.

Producent nie ponosi odpowiedzialności za produkt, gdy nie można było przewidzieć niebezpiecznych właściwości produktu, uwzględniając stan nauki i techniki w chwili wprowadzenia produktu do obrotu.

Można zatem z dużym prawdopodobieństwem założyć, że jeżeli producent robota wykaże, iż algorytm w systemie operacyjnym robota został stworzony z należytą starannością, a wszystkie podzespoły robota działały prawidłowo, będzie mógł zwolnić się z odpowiedzialności za autonomiczne decyzje podejmowane przez robota.

Na szczególną uwagę zasługuje w powyższym kontekście zagadnienie odpowiedzialności twórców systemu operacyjnego wykorzystywanego do produkcji robotów. Można sobie bowiem wyobrazić ewidentnie błędny algorytm stworzony w taki sposób, że robot z założenia ma swoimi działaniami naruszać przyjęte zasady postępowania. Jeżeli ten właśnie algorytm stał się bezpośrednią przyczyną szkody wyrządzonej przez robota, trudno znaleźć uzasadnienie dla wyłączenia odpowiedzialności twórcy oprogramowania. W takim wypadku twórca oprogramowania odpowiadałby na zasadzie winy. Nie można również wykluczyć w takim przypadku odpowiedzialności za produkt niebezpieczny.

Jakkolwiek produktem niebezpiecznym mogą być jedynie rzeczy ruchome, to odpowiedzialność za produkt niebezpieczny mogą ponosić również wytwórcy części składowych produktu (art. 4495 Kodeksu cywilnego).

Z drugiej strony przepisy prawa nie przewidują jakichkolwiek kryteriów, które pozwoliłyby obiektywnie ocenić, czy dany algorytm spełnia kryteria należytej staranności czy też nie. Oceny w tym zakresie należałoby dokonywać oddzielnie w odniesieniu do każdego analizowanego przypadku, co wiązać się może z arbitralnością i rozbieżnością rozstrzygnięć.

Ponadto, obecne przepisy dotyczące produktu niebezpiecznego przewidują, że bezpieczeństwo to jest zapewnione tylko w momencie wprowadzenia produktu na rynek. Zatem coraz trudniej będzie określić, kto powinien odpowiadać za szkodę wyrządzoną przez sztuczną inteligencję jako maszynę samoucząca się. Obecne rozwiązania prawne są więc niedostateczne, co doskonale widać choćby na przykładzie wypadków spowodowanych z wykorzystaniem pojazdów autonomicznych.

W tym miejscu należy zwrócić uwagę na kolejny problem jaki budzi kwestia zakwalifikowania wadliwego oprogramowania maszyny jako produktu niebezpiecznego. Zgodnie bowiem z art. 4491 § 2 k.c. produktem niebezpiecznym jest rzecz ruchoma, choćby została połączona z inną rzeczą. Jest nim także energia elektryczna. Oznacza to, że „ rozum i serce” inteligentnego robota – oprogramowanie, decydujące o jego autonomiczności, prima facie nie mogłoby zostać zakwalifikowane samo w sobie jako produkt. Oprogramowanie nie jest rzeczą ruchomą w rozumieniu art. 45 k.c., a jako dobro niematerialne nie jest produktem, za który producent odpowiada. Jak przyjmuje się w piśmiennictwie termin „rzecz ruchoma” trzeba interpretować funkcjonalnie, ponieważ ustawodawca, definiując produkt, przyjął szeroką i pojemną formułę pozwalającą na uznanie, że produktem są też dobra intelektualne (np. programy komputerowe) i w ogóle wszelkie „przypadki przedmiotów, które z uwagi na komercyjny sposób funkcjonowania w obrocie lub ze względu na zagrożenie, jakie stanowią dla otoczenia, zbliżają się w swym charakterze do typowych towarów, jakimi zajmuje się reżim odpowiedzialności za produkt. Uznając, że program komputerowy sam w sobie nie jest produktem, można stwierdzić także, że jako komponent produktu, który staje się jego nośnikiem, jako rzeczy ruchomej, będzie mógł być zakwalifikowany jako produkt. Innymi słowy, ponieważ produkt autonomiczny jest z reguły lub powinien być postrzegany jako składnik nośników będących rzeczami ruchomymi i oprogramowania, to niezależnie od tego, czy przyczyną szkody będzie samo jego oprogramowanie, czy także inne elementy, poszkodowany będzie mógł domagać się odszkodowania za wyrządzoną szkodę, jeżeli zostanie wykazane, że cały produkt (układ) wykazuje cechy produktu autonomicznego, a przez to niebezpiecznego” (patrz: Leszek Bosek, Perspektywy rozwoju odpowiedzialności cywilnej za inteligentne roboty).

Odpowiedzialność operatora na podstawie art. 415 k.c.

Odpowiedzialność producenta za produkt niebezpieczny nie wyłącza odpowiedzialności innych podmiotów za szkodę na innych podstawach prawnych, a w szczególności na podstawie art. 415 k.c. Zatem pojawia się pytanie jak szeroko można zakreślić odpowiedzialność operatora pojazdu autonomicznego lub inteligentnego robota na zasadach ogólnych. Art. 415 k.c. operuje formułą winy, umożliwiającą uwzględnienie różnych czynników zarówno o charakterze obiektywnym, jak i subiektywnym. Zgodnie z art. 415 k.c. każdy kto z winy swej wyrządził drugiemu szkodę, obowiązany jest do jej naprawienia. Jednak nikt nie odpowiada za przypadek, choćby wyrażający się w błędzie maszyny lub autonomicznej decyzji tej maszyny dotyczącej korekty kodu źródłowego, pod warunkiem że robot jest dopuszczony do obrotu, posiada odpowiednie atesty, a jego operator sam nie popełnił błędu, przyczyniając się do szkody.

Odnosząc powyższe rozważania do operatora autonomicznego robota, można stwierdzić, że odpowiedzialność na podstawie art. 415 k.c. nie powstanie w każdym przypadku wyrządzenia przez robota szkody. „Odpowiedzialność na podstawie art. 415 k.c. może ponieść tylko ten, kto wiedział o niebezpieczeństwie, które ujawniło się wskutek autokorekty algorytmu robota, albo osoba, która powinna wiedzieć o niebezpieczeństwie, pod warunkiem że spoczywa na niej prawny obowiązek zapobiegania niebezpieczeństwu. Zatem nie można przypisać odpowiedzialności operatorowi za nieprzewidywalne, niebezpieczne i powodujące szkodę zachowanie maszyny. Niemożliwy do spełnienia byłby obowiązek ciągłego kontrolowania autonomicznego robota. Ponadto jego użytkownik nie będzie z zasady dysponował kodami źródłowymi ani specjalistyczną wiedzą. Nie można też od nikogo wymagać badania staranności producenta produktu autonomicznego co do wyposażenia robota w niezbędne zabezpieczenia. Na nikim bowiem nie ciąży powszechny obowiązek ustawicznego badania, czy dopuszczone do obiegu (atestowane) roboty gwarantują bezpieczeństwo. Nie można bowiem na nikogo nakładać obowiązku badania kwalifikacji zawodowców, w tym przypadku producentów najbardziej zaawansowanych technologicznie produktów. Przyjęcie odmiennego poglądu rodziłoby ten skutek, że korzystanie z autonomicznych robotów byłoby zbyt ryzykowne dla lekarzy i podmiotów leczniczych, co z kolei hamowałoby rozwój nowych technologii w zakresie ochrony zdrowia, co najmniej zniechęcając polskie podmioty do nabywania takich zaawansowanych produktów”. (patrz: Leszek Bosek, Perspektywy rozwoju odpowiedzialności cywilnej za inteligentne roboty).

Reasumując, operator robota może ponosić zatem odpowiedzialność za nieprawidłowe posługiwanie się robotem, ale nie jest to odpowiedzialność za skutek, lecz co najwyżej za brak należytej staranności w przeciwdziałaniu wystąpienia szkody, gdyż z natury rzeczy nie może odpowiadać za autonomiczne decyzje robota, na które nie ma wpływu.

Sztuczna inteligencja a polskie prawo cywilne – sugestie

W doktrynie pojawiła się koncepcja aby do wypadków z udziałem pojazdów autonomicznych stosować aktualne polskie uregulowania. Użyte bowiem w art. 436 Kodeksu cywilnego pojęcie mechanicznego środka komunikacji ujmowane jest szeroko. Zatem mechanicznym środkiem komunikacji jest pojazd:

• „napędzany własnym silnikiem, poruszanym za pomocą sił przyrody, przy czym nie jest istotne, czy porusza się na lądzie (po jezdni, po wydzielonym torowisku itp.), na wodzie czy w powietrzu 2373 , a także w jaki sposób dostarczana jest energia (np. ze zbiornika paliwa, z baterii słonecznych, z trakcji), a także sposób kierowania pojazdem (przez człowieka, zdalnie lub jako tzw. pojazdy samokierujące itp.); przykładowo będą to więc: samochód osobowy, ciężarowy, motocykl, skuter, motorower, samolot śmigłowy, odrzutowiec, lokomotywa spalinowa, elektryczna, parowóz, tramwaj, autobus, trolejbus (ale jeśli są częścią przedsiębiorstwa – zob. komentarz do art. 435)” (Wałachowska Monika i Ziemiak Michał P.. Art. 436. W: Kodeks cywilny. Komentarz. Tom III. Zobowiązania. Część ogólna (art. 353-534). Wolters Kluwer Polska, 2018),

• służy do komunikacji – wyłączone są zatem spod zakresu zastosowania tego przepisu pojazdy silnikowe niesłużące do komunikacji, a więc np. windy, schody ruchome, dźwigi, podnośniki, koparki, kombajny, spychacze, albo takie urządzenia, które wprawdzie są przeznaczone do komunikacji, ale tylko ich pewien element ma charakter ruchomy 2374 (np. winda, schody ruchome, wyciąg narciarski, kolej linowa); Nie mieszczą się w tej kategorii np. urządzenia służące do „przewożenia” towaru w magazynie itp. Wprawdzie mają silnik, ale z natury rzeczy nie służą do komunikacji.

W zasadzie jest to każde urządzenie mechaniczne służące celom komunikacji, przy czym pod pojęciem komunikacji należy rozumieć przemieszczanie towarów bądź też ludzi. Komunikacja w języku polskim oznacza bowiem „ruch środków lokomocji między odległymi od siebie miejscami; też drogi, szlaki i środki lokomocji”, „możliwość przedostania się z jednego pomieszczenia, miejsca do drugiego”.

Problematyczne jednak jest to, iż dźwigi czy suwnice portowe nie służą do komunikacji, gdyż poruszają się jedynie po torowisku wzdłuż burty statku, a zatem wymykają się klasycznej definicji mechanicznego środka komunikacji i w tym zakresie obecne prawo polskie wymagałoby zmian. Tym samym pojazd autonomiczny spełnia przesłanki do uznania go za mechaniczny środek komunikacji.

Niemniej cecha pojazdu autonomicznego – to, że prowadzi się on sam, wywołuje pytanie o potrzebę modyfikacji ogólnych zasad odpowiedzialności odszkodowawczej z tytułu ruchu pojazdów mechanicznych.

Warianty odpowiedzialności

Możliwe są 4 warianty wypadków:

a) wypadek pojazdu autonomicznego z „pieszym”,

b) zderzenie pojazdu autonomicznego z tradycyjnym pojazdem mechanicznym,

c) zderzenie pojazdów autonomicznych,

d) spowodowanie szkody u współposiadacza pojazdu autonomicznego lub osoby przewożonej z grzeczności.

Wypadek pojazdu autonomicznego z „pieszym”

Rozważając ten wariant wypadku, należy zaznaczyć, że odpowiedzialność za szkody spowodowane wypadkiem z udziałem pojazdu autonomicznego, podobnie jak tradycyjnego pojazdu mechanicznego, oparta może być na zasadzie ryzyka. Takie podejście jest konsekwencją stwierdzenia, że źródło niebezpieczeństwa tkwi w samym pojeździe. Sam bowiem jego ruch jest postrzegany jako zdarzenie wywołujące zwiększone ryzyko powstania szkody, które w całości powinno obciążać posiadacza pojazdu. Ponadto w tym przypadku jest on nie tylko wprawiany w ruch za pomocą sił przyrody, ale dodatkowo jego operator ma nad nim ograniczoną kontrolę. Dlatego należy uznać, że przyjęcie odpowiedzialności na zasadzie winy byłoby w tej sytuacji dla poszkodowanego niekorzystne, a ponadto utrudniałoby bądź wykluczyłoby w wielu przypadkach możliwość żądania naprawienia szkody, gdyż nie zawsze istniałyby podstawy do postawienia sprawcy szkody zarzutu zawinionego działania lub zaniechania.

Z drugiej jednak strony posiadacz pojazdu autonomicznego może mieć niewielki wpływ na jego prowadzenie będzie zależny jedynie od techniki zaoferowanej mu przez producenta pojazdu i oprogramowania. W związku z tym trzeba znaleźć odpowiedź na pytanie: czy w przypadku pojazdu autonomicznego to operator jest odpowiedzialny za szkodę, czy też może raczej producent pojazdu/oprogramowania, na zasadach zbliżonych do odpowiedzialności za produkt niebezpieczny (art. 4491 i n. k.c.)? Może zdarzyć się bowiem sytuacja, że zaistniały wypadek będzie skutkiem wadliwej konstrukcji lub oprogramowania pojazdu autonomicznego lub też błędnej reakcji na dane zdarzenie drogowe, którego nie przewidział ani producent pojazdu, ani oprogramowania.

W takiej sytuacji należałoby uznać, że wypadek był skutkiem przyczyny tkwiącej w samym produkcie, a wadliwość tę można było przewidywać, biorąc pod uwagę stan nauki i techniki w chwili wprowadzenia produktu do obrotu, co stanowi tzw. ryzyko rozwoju (art. 4493 § 2 k.c. w zw. z art. 4491 § 3 k.c.). Ciężar wykazania, że danej wadliwości nie można było przewidzieć, obciążałby producenta pojazdu. Ponadto, jak wskazano wyżej, odpowiedzialność może ponosić również producent jednego z jego podzespołów czy oprogramowania (art. 4495 § 1 k.c.). Producent oraz wytwórca materiału, surowca albo części składowej, importer odpowiadają solidarnie.

Możliwe byłoby przerzucenie odpowiedzialności na operatora pojazdu autonomicznego, gdyby jego producent udowodnił, że operator mógł uniknąć wypadku poprzez np. przejęcie kontroli nad pojazdem autonomicznym, zwłaszcza gdy pojazd ten sygnalizował zbliżające się niebezpieczeństwo. Oczywiście inną przesłanką zwalniająca z odpowiedzialności dla producenta pojazdu byłoby wykazanie, że wyłączną przyczyną wypadku była wina poszkodowanego lub osoby trzeciej. Dlatego biorąc pod uwagę, że mamy do czynienia z nową technologią, od której całkowicie jest uzależniony operator, co do zasady to producent pojazdu lub oprogramowania powinien w omawianym przypadku odpowiadać za wypadek spowodowany przez pojazd autonomiczny.

Zderzenie pojazdu autonomicznego z tradycyjnym pojazdem mechanicznym lub autonomicznym

Drugi i trzeci rodzaj wypadków dotyczy zderzenia pojazdu autonomicznego z tradycyjnym pojazdem mechanicznym lub zderzenia wyłącznie pojazdów autonomicznych. W obu przypadkach problematyczny jest punkt wyjścia: w razie zderzenia kodeks cywilny odwołuje się do odpowiedzialności na zasadach ogólnych (art. 436 § 2 k.c.), czyli do zasady winy (art. 415 k.c.). Skoro pojazd autonomiczny prowadzi się sam, oznaczałoby to, że odpowiedzialnością za wypadek zwykle byłby obarczany kierowca pojazdu nieautonomicznego lub, w przypadku zderzenia pojazdów autonomicznych, nikt - bowiem pojazdowi autonomicznemu winy przypisać nie można. Takie podejście wywołuje jednak kontrowersje. Należy zauważyć, że co do zasady w razie kolizji pojazdu autonomicznego z pojazdem mechanicznym w większości przypadków wystąpi wina kierowcy tego drugiego pojazdu. Wynika to z tego, że zwykle przyczyną wypadku jest czynnik ludzki. W takim wypadku odpowiedzialność wystąpi na zasadzie ryzyka.

Mogą się jednakże zdarzyć sytuacje, że nie zawsze będziemy mieli do czynienia z takim przypadkiem, gdyż wypadek będzie skutkiem np. wadliwości pojazdu autonomicznego. Wówczas należy przyjąć konstrukcję odpowiedzialności taką, jaka występuje przy wypadku z udziałem niezmotoryzowanego uczestnika ruchu drogowego. Mógłby ją więc ponieść albo operator pojazdu autonomicznego, jako osoba, która godzi się na ryzyko jego zakupu i użytkowania, albo producent w ramach reżimu odpowiedzialności za produkt niebezpieczny, chyba że wykaże, że operator, mając możliwość zareagowania i uniknięcia wypadku, nie zrobił tego z własnej winy.

Zderzenie pojazdów autonomicznych

W przypadku zderzenia się dwóch pojazdów autonomicznych, przyczyną wypadku zawsze będzie wadliwości jednego z pojazdów w nim uczestniczących. Z założenia bowiem pojazdy te winny rozpoznawać otoczenie drogowe i poruszać się na nich się z poszanowaniem zasad ruchu drogowego. Jeżeli więc dojdzie do tak, na tym etapie nieprawdopodobnego, zdarzenia odpowiedzialność cywilną za zderzenie powinien ponosić co do zasady albo jego operator, albo producent. Jednak wydaje się, że bardziej zasadne byłoby obciążenie w tej sytuacji odpowiedzialnością producenta za produkt niebezpieczny, gdyż do zderzenia pojazdów autonomicznych, uwzględniając obecny stan wiedzy, może dojść na skutek wady w konstrukcji lub oprogramowania pojazdu.

Spowodowanie szkody u współposiadacza pojazdu autonomicznego lub osoby przewożonej z grzeczności.

Zgodnie z art. 436 §2 Kodeksu cywilnego, w przypadku wyrządzenia szkody u współposiadacza pojazdu mechanicznego lub osoby przewożonej z grzeczności, posiadacz pojazdu mechanicznego odpowiada na zasadzie winy wobec współposiadacza pojazdu lub osób przewożonych z grzeczności. Problem z pojazdem autonomicznym może polegać na tym, iż operator i osoba jadąca z nim pojazdem autonomicznym zwykle są współpasażerami pojazdu i żaden z tych podmiotów nie ma wpływu na jego prowadzenie.

Dlatego należałoby uznać, że co do zasady to producent pojazdu autonomicznego lub oprogramowania powinien odpowiadać wobec tych osób w ramach reżimu odpowiedzialności za produkt niebezpieczny. Odpowiedzialność mogłaby być przerzucona na operatora pojazdu autonomicznego w sytuacji, kiedy ten był w stanie zareagować na sytuację drogową, a nie uczynił tego w okolicznościach, w których można mu przypisać winę.

IV. Prace legislacyjne

Na początku lutego 2017 w Parlamencie Europejskim odbyło się dwudniowe seminarium poświęcone rozwojowi robotyki oraz sztucznej inteligencji. W jego trakcie uczestnicy analizowali raport "Świat robotów w kontekście wyzwań prawa cywilnego" przygotowany przez komisję spraw prawnych JURI. Znalazły się w nim zapisy dotyczące najważniejszych zagadnień związanych z wyzwaniami, jakie niesie rozwój robotyki oraz sztucznej inteligencji m. in. w obszarze prawa cywilnego. Efektem tego seminarium było podjęcie rezolucji z zaleceniami dla Komisji w sprawie wprowadzeniu przepisów prawa cywilnego, które miałyby nadążyć nad duchem dzisiejszych czasów.

Parlament Europejski w rezolucji z 16 lutego 2017 o przepisach prawa dotyczących robotyki (patrz: Rezolucja Parlamentu Europejskiego z dnia 16 lutego 2017 r. zawierające zalecenia dla Komisji w sprawie przepisów prawa cywilnego dotyczących robotyki (2015/2103(INL)) (Dz. U. UE. C. z 2018 r. Nr 252, str. 239)), stwierdza w pkt. 53, że w zakresie odpowiedzialności „przyszły instrument prawny powinien być oparty na szczegółowej ocenie (…), czy należy zastosować odpowiedzialność na zasadzie ryzyka czy też podejście zakładające zarządzanie ryzykiem”. W kolejnych punktach podkreśla się, „że odpowiedzialność na zasadzie ryzyka wymaga jedynie dowodu powstania szkody oraz ustalenia związku przyczynowo-skutkowego pomiędzy szkodliwym funkcjonowaniem robota a szkodą, jaką poniosła dana osoba. Natomiast podejście zakładające zarządzanie ryzykiem nie skupia się na osobie, która działała w sposób niedbały jako ponoszącej odpowiedzialność indywidualną, ale na osobie, która może, w określonych okolicznościach, zminimalizować ryzyko i podjąć działania w odniesieniu do negatywnych skutków”. Parlament Europejski „jest zdania, że po wskazaniu ostatecznie odpowiedzialnych stron ich odpowiedzialność powinna zasadniczo być proporcjonalna do poziomu instrukcji, jakie wydano robotowi, i stopnia jego autonomii; (…) przynajmniej na obecnym etapie odpowiedzialność musi spoczywać na człowieku, a nie na robocie; (…) ewentualnym rozwiązaniem złożonego problemu ustalania odpowiedzialności za szkody spowodowane przez coraz bardziej autonomiczne roboty może być ubezpieczenie obowiązkowe, na wzór ubezpieczeń samochodowych”.

V. „Osoba elektroniczna” a odpowiedzialność

Co również ciekawe Komisja Europejska nie wyklucza, że wyjątkowo zaawansowane maszyny mogą w przyszłości stać się „osobami elektronicznymi”, której prawo przyznawałoby zapewne podmiotowość.

Zresztą już w dzisiejszych czasach następuje i w tej kwestii pewna rewolucja. W 2017 roku Japonia przyznała prawo do stałego pobytu w Tokio sztucznej inteligencji o imieniu Mirai. Ta Sztuczna inteligencja została stworzona na podobieństwo 7-letniego chłopca i nie ma sztucznego ciała. Inaczej niż w przypadku Sophii stworzonej przez Hanson Robotics. Sophia otrzymała obywatelstwo Arabii Saudyjskiej, co biorąc pod uwagę sytuację kobiet w tym kraju wywołało zrozumiałe kontrowersje.

Z kolei wiosną 2017 r. w Belgii, w urzędzie stanu cywilnego zarejestrowany został robot pod imieniem i nazwiskiem Fran Pepper. Nadawanie „osobowości elektronicznej” jest postulowane przede wszystkim przez producentów robotów, z których zrzuca odpowiedzialność za ich postępowanie oraz ew. wyrządzone szkody a nawet przestępstwa. Takie podejście budzi jednak uzasadnione kontrowersje. Można się zastanawiać kto powinien zostać pociągnięty do odpowiedzialności w przypadku robota posiadającego „osobowość elektroniczną”, którego działanie było zgodne z wgranym algorytmem? W jaki sposób autonomiczne roboty miałyby ponosić odpowiedzialność za czyny, które popełniły.

Próby uregulowania problematyki związanej z zastosowaniem pojazdów autonomicznych zostają podjęte obecnie w większości krajów wysokorozwiniętych. W tej kwestii, oprócz USA czy Niemiec, prace trwają również w Japonii. Obecnie prace legislacyjne są w fazie analiz lub ogólnonarodowej dyskusji, lecz z pewnymi wyjątkami pierwszych uregulowań dokonała np. Polska lub Niemcy. Z kolei Japonia planuje wprowadzenie przepisów, zgodnie z którymi za wypadki będzie odpowiedzialny, co do zasady, właściciel pojazdu, a producent tylko, jeśli samochód byłby wadliwie wyprodukowany. Zhakowanie pojazdu autonomicznego miałoby być traktowane jak kradzież samochodu (posiadanie samoistne?), ale właściciel pojazdu autonomicznego aby uwolnić się od odpowiedzialności cywilnej będzie musiał zadbać o jego odpowiednie zabezpieczenia, np. aktualizacje oprogramowania pojazdu.

VI. Podsumowanie

Wprowadzenie pojazdów autonomicznych oraz robotów wspomagających prace portowe będzie stanowiło wyzwanie nie tylko dla przedsiębiorcy portowego ale i dla ustawodawcy i judykatury. Trzeba będzie bowiem dokonać ustalenia, kto ponosi odpowiedzialność cywilną za szkody cywilne z udziałem takich maszyn. Oczywistym jest, iż producenci oprogramowania czy wreszcie maszyn będą lobbowali za ograniczeniem swojej odpowiedzialności w przyszłości forsując zapewne stanowisko przyjęcia koncepcji „osoby elektronicznej lub przerzucenia odpowiedzialności na użytkownika robota lub przedsiębiorstwo, które nim się posługuje.

Nie ma wątpliwości, że ruch pojazdów autonomicznych, w tym dźwigów, żurawi, suwnic portowych w związku z ryzykiem, jakie będzie wiązało się z ich użytkowaniem, jak małe by ono nie było, będzie zapewne wiązało się z koniecznością ubezpieczenia takiego urządzenia od odpowiedzialności cywilnej, co stawia kolejne wyzwania. Ustawodawca powinien rozstrzygnąć, czy będzie to obowiązek obciążający operatora, jak w przypadku tradycyjnych pojazdów mechanicznych, czy producenta, jako podmiotu odpowiedzialnego za wprowadzenie na rynek produktu niebezpiecznego, na którego działanie użytkownik prawie nie ma wpływu. Uregulowanie tej materii jest konieczne, aby uniknąć w przyszłości dwuznaczności i rozbieżności w orzecznictwie, a także zapewnić jak najpełniejszą ochronę poszkodowanych w wypadkach, które nie powinny być postawione w sytuacji, w której to nie wiedzą w istocie do kogo należy skierować roszczenie.

Przyszłe ustawodawstwo powinno być oparte na szczegółowej ocenie, czy zastosować należy odpowiedzialność na zasadzie ryzyka czy też zakładające zarządzanie ryzykiem. Ponadto, na obecnym etapie rozwoju nauki i techniki odpowiedzialność deliktowa zgodnie z rezolucją Parlamentu Europejskiego winna spoczywać na osobie fizycznej (prawnej), a nie na robocie. Nadanie robotom specjalnego statusu prawnego w perspektywie długoterminowej, aby przynajmniej najbardziej rozwiniętym robotom autonomicznym można było nadać status osób elektronicznych odpowiedzialnych za naprawianie wszelkich szkód, jakie mogłyby wyrządzić, wywołuje liczne dyskusje, gdyż społeczeństwo nie jest jeszcze przygotowane mentalnie, kulturowo, ani cywilizacyjnie na tak daleko posuniętą rewolucję. Ponadto przyjmuje się, że nadanie osobowości maszynom nie rozwiąże już istniejących problemów natury prawnej, ale stworzy nowe jeszcze bardziej skomplikowane problemy tej samej natury.

Zatem do czasu wprowadzenia rozwiązań legislacyjnych, które odpowiadałyby duchowi czasu, odpowiedzialność portu morskiego za ewentualne działania autonomicznych urządzeń portowych będzie zapewne opierać się na zasadzie wynikającej z art. 435 k.c. tj. odpowiedzialność na zasadzie ryzyka osób prowadzących przedsiębiorstwo.

Radca prawny - Mateusz Romowicz

http://www.kancelaria-gdynia.eu

www.facebook.com/Legal.Marine.Mateusz.Romowicz

Autor jest radcą prawnym w Kancelarii Radcy Prawnego Legal Consulting - Mateusz Romowicz.